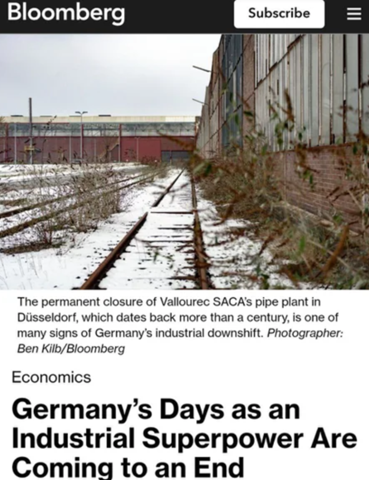

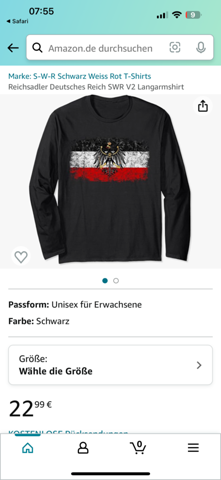

Hat sich Deutschland, das früher weltweit hoch angesehen war, eurer Meinung nach in den letzten 20 Jahren positiv entwickelt?

Verwandte Themen

Hat sich Deutschland in den letzten 20 Jahren positiv entwickelt?

Europa,

Arbeit,

Geld,

Geschichte,

Wirtschaft,

Deutschland,

Politik,

Demokratie

Habt ihr Angst vor Nazis?

Deutschland,

Politik,

Gesellschaft,

Nationalsozialismus,

Rechtsextremismus