Äquivalenz der Stetigkeitsbegriffe (Epsilon-Delta vs. Folgenstetigkeit)?

Hallo,

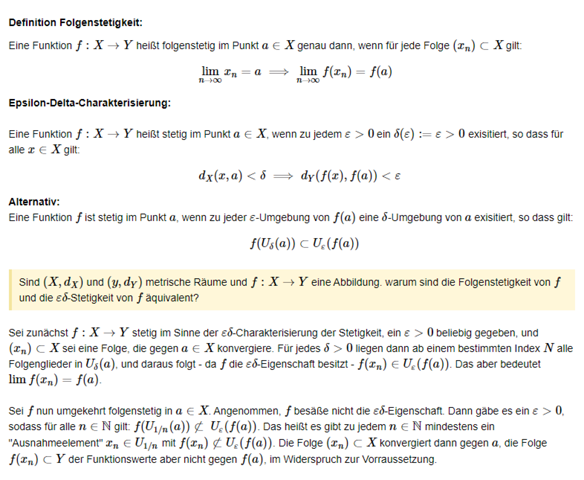

ich habe hier mal den Beweis aus meinem Lehrbuch niedergeschrieben, oben sind auch die verwendeten Definitionen:

Ich verstehe den ersten Teil, wo bewiesen wird, dass aus der Stetigkeit durch die Epsilon-Delta-Definition auch die Folgenstetigkeit folgt, andersherum verstehe ich es aber nicht. Warum spricht man auf einmal von der U_(1/n)-Umgebung statt von U_delta?

1 Antwort

Das ist ein Standardtrick bei derartigen Beweisen. Du nimmst an, es existiert ein epsilon > 0, sodass es für alle delta > 0 ein y gibt, sodass zwar |x-y| < delta, aber |f(x)-f(y)| >= epsilon gilt. Für delta setzt du jetzt gezielt 1/k für natürliche k ein. Dann gibt es also zu jedem 1/k ein y_k, sodass |x-y_k| < 1/k gilt, aber |f(x)-f(y_k)| >= epsilon. Dann konvergiert y_k gegen x, f(y_k) jedoch nicht gegen f(x).

Also. Du willst zeigen, dass aus Folgenstetigkeit das Epsilon-Delta-Kriterium folgt. Das machen wir mit der Kontraposition, d.h. wir nehmen an, dass das Epsilon-Delta-Kriterium nicht gilt und zeigen damit, dass eine Folge (x_n) existiert, die zwar gegen x konvergiert, f(x_n) konvergiert aber nicht gegen f(x). Die Negation des Epsilon-Delta-Kriteriums lautet "Es existiert ein epsilon > 0, sodass für alle delta > 0 ein y existiert, sodass die Implikation "|x-y| < delta ==> |f(x)-f(y)| < epsilon" nicht gilt. Dass diese Implikation nicht gilt, ist gleichbedeutend damit, dass die Aussagen |x-y| < delta und |f(x)-f(y)| >= epsilon richtig sind (dann ist der Teil vor dem Implikationszeichen wahr und der Teil dahinter falsch und das ist die einzige Möglichkeit, um eine Implikation falsch zu machen). Da diese Aussage für alle delta > 0 gilt, setzen wir für jede natürliche Zahl k > 0 jetzt delta = 1/k. Dann existiert für jedes delta, also für jedes 1/k, ein y (dieses nennen wir jetzt y_k statt y, damit jeweils klar ist, auf welches k sich unser y bezieht), sodass gilt: |x-y_k| < 1/k und |f(x)-f(y_k)| >= epsilon. Da 1/k gegen 0 konvergiert, nähert sich y_k immer weiter an x an, d.h. y_k konvergiert gegen x. f(y_k) kann aber nicht gegen f(x) konvergieren, da jedes f(y_k) einen Mindestabstand von epsilon zu f(x) hat, d.h. f(y_k) kann sich nicht beliebig nah an f(x) annähern.

Hi, das hat mein Verständnis leider nicht positiv beeinflusst. Ich werde mir nochmal Gedanken machen.