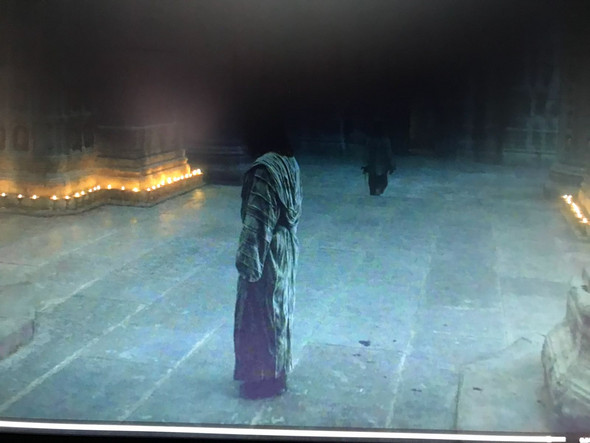

In den letzten Jahren gibt es immer mehr schwarze Schauspieler, die Rollen von weißen Charakteren übernehmen. Um klarzustellen, ich habe nichts gegen schwarze Schauspieler. Besonders störend finde ich es bei historischen Filmen/Serien. In den meisten Fällen ergibt es einfach keinen Sinn. In vielen Filmen kommt es mir daher sehr erzwungen voll. Ich verstehe nicht warum das aktuell so ein Trend ist. Es gibt doch genug Möglichkeiten um logisch schwarze Charakter einzubauen, warum müssen Sie immer weiße Rollen übernehmen? Früher hat es so ja auch gut geklappt. Zusätzlich stört mich dieses werben. "UNSER FILM IST SO DIVERS, SCHAUT IHN EUCH AN". Zusätzlich finde ich es immer Scheinheilig das hauptsächlich schwarze Schauspieler genommen werden, aber was ist mit Asiaten, Indern etc? Welche Botschaft soll mir das als Zuschauer vermitteln? Ich möchte einfach nur einen Film genießen und mir keine politischen Botschaften anschauen.

Verwandte Themen

Schwarze übernehmen weiße Rollen?

Männer,

Geschichte,

Frauen,

Filme und Serien,

Hautfarbe,

Rassismus,

Amazon Prime,

hbo,

Netflix,

Disney Plus